В Госдуме разрабатывают закон о маркировке контента, созданного искусственным интеллектом

В конце прошлого года Всероссийский центр изучения общественного мнения (ВЦИОМ) опубликовал результаты исследования, которые показали, что существует проблема маркировки ИИ-контента и она волнует многих пользователей: тогда 69% опрошенных россиян поддержали введение маркировки ИИ-контента.

В этом направлении Министерство цифрового развития, связи и массовых коммуникаций анонсировало разработку платформы для выявления дипфейков, созданных с применением ИИ. Это стало частью стратегии национального проекта «Экономика данных», инициированного премьер-министром Михаилом Мишустином. По словам представителя Минцифры, рассмотрение возможности создания единой платформы для выявления фейковой информации, включая дипфейки, открывает новые перспективы в борьбе с дезинформацией. Однако для определения стратегии в решении этого вопроса требуется провести глубокие исследования для определения эффективных методов обнаружения и анализа поддельных материалов, созданных при помощи ИИ. Что вызывает сейчас бурные обсуждения в цифровой среде.

14 мая член комитета ГД по информполитике Антон Немкин сообщил, что госдума начала разрабатывать законодательную инициативу по маркеровке контента, созданного нейросетями. Депутат также отметил, что законопроект разрабатывается совместно с экспертами и основываясь на опыте других стран. Каких именно экспертов и какие именно страны рассматриваются, как пример работы с маркировакой контента, созданного ИИ, Немкин не уточнил.

По словам Немкина, человеку важно иметь представление о том, с чем он имеет дело, отличать реальное от нереального, как и в случае с рекламой, - пользователя очень легко обмануть и завлечь куда-то, а задача государства не позволить это сделать. Депутат также поделился эстетической стороной вопросы, по его мнению маркировка может осуществляться при помощи графических или водяных знаков,она должна быть «ненавязчивой, но при том четкой и заметной для любогог пользователя».

По мнению Немкина, в силу того, что пока не ясно, какая экспертиза позволит распознавать степень участия машины и человека в одном и том же тексте, российские ИИ-сервисы должны автоматически маркировать любые сгенерированные тексты. В первую очередь, задуматься над подобными технологиями цифровой маркировки изображений нужно российским компаниям, развивающим компетенции в области генеративных нейросетей - прежде всего, "Сберу" и "Яндексу", предложил Немкин.

Пока Немким акцентирует внимание на текстовом контенте, мы обратились к опыту других стран и посмотрели, какой именно ИИ контент больше всего нуждается в регулировании и маркеровки. В контексте информационной безопасности, обнаружение и маркировка дипфейков является основным фокусом у государтсв.

На сегодняшний день выявление дипфейков не автоматизировано и пока основано преимущественно на анализе контента специалистами по информационной безопасности и криминалистами в ручную. Ведущие IT-специалисты видят несколько вариантов для решения проблемы с дипфейками. Одним из предложенных решений является разработка плагина, который будет автоматически сканировать веб-сайты на наличие контента, созданного с использованием искусственного интеллекта. Однако вопрос о его интеграции в социальные сети и мессенджеры остается открытым, и зависит от готовности их владельцев к такому изменению.

В других странах уже ведутся разработки интеллектуальных систем для определения сгенерированного контента. Intel представил технологию FakeCatcher для обнаружения дипфейков в реальном времени. Как заявляет производитель, детектор обладает точностью 96 % и анализирует цветовые изменения кожи, характерные только для настоящих людей. В процессе работы используются инструменты Intel, включая OpenVino, OpenCV и Deep Learning Boost.

Онлайн-инструмент Sensity обнаруживает поддельные лица на фото и видео с помощью методов глубокого обучения и судебной экспертизы.

Для эффективного мониторинга и обнаружения дипфейков в социальных сетях, возможно, потребуется разработка специализированного ПО или получение доступа к API платформ. Также обсуждается вопрос о внедрении водяных знаков как средства защиты от неправомерного использования ИИ-контента. Хотя при этом стоит учитывать, что для сервисов такая маркировка может оказаться невыгодной, если она не станет обязательной. Таким образом, необходимо провести дальнейшие обсуждения и принять соответствующие нормативные акты.

В зарубежном опыте уже есть примеры использования маркировки контента, созданного с применением ИИ. Например, в Китае маркировать ИИ-контент необходимо в популярном сервисе TikTok. В США еще в прошлом году власти пришли к соглашению с крупными разработчиками генеративного ИИ о маркировке сгенерированного в их сервисах контента. Так на YouTube создатели должны указывать, если их видео были сделаны с помощью ИИ. Платформа представила новый инструмент в Creator Studio, который требует раскрытия информации об этом, если контент может быть воспринят зрителями как реальный.

Ну вот почему у нас так не переносят любое проявление предприимчивости

Разместил намедни пост на Пикабу, где попросил мнение по поводу своего сайтика. Даже не о самом сайтике, а о его возможном смысле для покупателя как продукта (купите или нет). Ссылку, естественно, в посте не давал. Просто проверка теории. Да, проект спорный. Естественно, сырой. И я его, скорее всего, закрою. По сим причинам сам проект оценивать не просил, хотел узнать мнение лишь касательно коммерческого смысла задумки. Не прошло и получаса, как в комментариях образовался целый отряд тестировщиков и стартап-аналитиков, спешащих сообщить мне что "твой очередной высер никому не нужен", "аудитория твоего проекта - никто" и иже с тем подобное. А ведь эти люди меня даже не знают. И я даже ничего плохого им не делал.

Почему так происходит? Моя теория следующая: средний пост-советский обыватель имеет ну просто вагон идей о том, как стать "миллеардером". Но у каждой из идей есть крайне неприятная побочка - её нужно реализовывать. Вкладывать силы, нервы, деньги, время. Гораздо приятнее сидеть на печи (простите, на Пикабу). Ну и если, не приведи Господь, на горизонте образуется хоть кто-то, кто всё же слез с печи, у обывателя начинается паника в духе: "А вдруг у него получится?! Это что же, он будет лучше меня? Надо срочно всё засрать!". И с самим проектом такое мнение никак не связано.

Напишите в комментариях, есть ли доля разума в моих рассуждениях, или же всё на поверхности: сделал гавно, его и обосрали.

Как подготовить машину к долгой поездке

Взять с собой побольше вкусняшек, запасное колесо и знак аварийной остановки. А что сделать еще — посмотрите в нашем чек-листе. Бонусом — маршруты для отдыха, которые можно проехать даже в плохую погоду.

Почему вы не стали бы платить за дипфейк-порно

Я создал сайт - генератор дипфейк-порно. Естественно, не рекламирую. Создавал больше для себя, т.к. адекватного подобного сервиса в сети не нашел. В каждом из существующих требуют загрузить собственное видео для подмены лица, а также оформить подписку. А я, во-первых, не хочу искать видео, которое можно скачать - на современных порно-сайтах отсутствует опция скачивания, что создает доп. трудности. Во-вторых, не хочу платить подписку - потребность возникла лишь однажды, регулярной нужды нет. Сделал сервис, где ты загружаешь фото и тебе предлагается набор видео на выбор, за каждое из которых можно заплатить отдельно (бесплатно не получится, т.к. я тоже плачу за работу мощного видео-адаптера).

В общем, попробовал опубликовать в открытый доступ - все играются, но никто не готов платить. Выразите ваше мнение, почему вы не стали бы платить за подобное (или стали), и вообще, нужен ли такой сервис, и если нет, то почему. Жду комментариев, спасибо.

Заменить лицо на видео или фото!

Для замены лица на видео или фот нам поможет известная нейронная сеть Дипфейк. Искусственный интеллект обучен качественно заменять лицо на нужном фрагменте видео или фото, которое трудно отличить от оригинала после обработки.

В этой статье мы рассмотрим сайты с помощью которых вы можете создать свой Дипфейк.

В 2024 году на рынке можно найти большое количество программ и сервисов, которые производят процесс замены лица онлайн и за несколько секунд. Мы подготовили сборник лучших нейросетей для создания Deepfake, как для новичков, так и для опытных пользователей. Изучай и пользуйся!

Reface

Одно из самых популярных и удобных приложений для создания дипфейков на мобильных устройствах, работающих под управлением Android и iOS. С помощью Reface даже неопытный пользователь легко сгенерирует мем или дружеский шарж. Программа использует универсальную нейросеть, которую разработчики обучили на миллионах изображений из открытых библиотек. Благодаря тому, что пользователю обучать нейросеть не нужно, создание дипфейкового видео или фотографии занимает несколько минут.

NeuralNude — это нейросеть для создания фото и видео дипфейков, которая работает онлайн и не требует скачивания на смартфон или ПК. Эта нейронкая сеть имеет преимущество перед другими. Потому как вы можете загружать своë видео или фото и сделать из него Дипфейк. Эта функция доступна в телеграм боте от сайта.

Нейросеть NeuralNude работает таким образом, что есть обработки, которые позволяют попробовать функции сайта. Стоит отметить, что нейросеть работает быстро и качественно. В результате итог получается достаточно привлекательным, и при этом можно не переживать о том, что сайт будет не безопасным – вся информация о пользователе шифруются в системе.

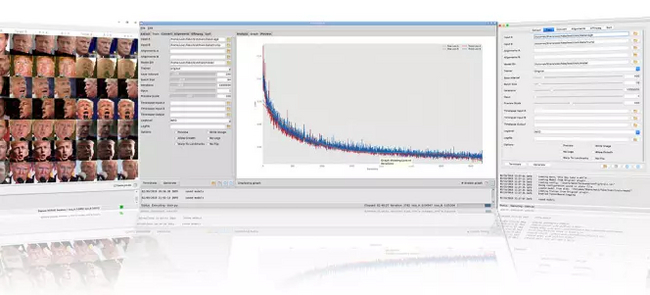

Необходимо заснять лицо, которое предстоит вставлять в видео, в разных ракурсах. Первая тренировка ИИ занимает довольно много времени (около суток). По утверждению разработчиков, впоследствии при использовании тех же моделей для обучения нейросети понадобится меньше времени. После вставки изображения в видео требуется цветокоррекция. Программа предназначена для опытных пользователей, знакомых с основами программирования.

При создании дипфейков необходима обработка как исходного, так и результирующего видео. Чтобы быстро вырезать фрагмент из фильма, а при необходимости преобразовать его в GIF-анимацию, проще всего использовать Movavi Video Editor. Специально для таких случаев в приложении предусмотрен инструмент автоматического распознавания и вырезания отдельных сцен.

ВЫ ВСЕ Г*ВНО!

У меня ПК не тянет так бы вообще без артефактов и искажений получилось. Если хотите попробовать залетайте на YouTube там подробная инструкция.